على مدى السنوات القليلة الماضية، تطورت نماذج الذكاء الاصطناعي التوليدي في مجال علوم الحاسوب باستمرار، مما مكّنها من إنشاء محتوى مخصص بناءً على مدخلات أو تعليمات محددة. وعلى الرغم من التطبيق الواسع لنماذج توليد الصور، إلا أن التحكم الدقيق في الصور الناتجة لا يزال يمثل تحديًا كبيرًا. في مؤتمر الرؤية الحاسوبية والتعرف على الأنماط (CVPR 2025) الذي عُقد في الفترة من 11 إلى 15 يونيو في ناشفيل، قدم باحثو NVIDIA ورقة بحثية تسلط الضوء على طريقة تعلم آلي جديدة تُدعى DiffusionRenderer، تهدف إلى تطوير توليد وتحرير الصور، مما يتيح للمستخدمين ضبط خصائص الصور بدقة.

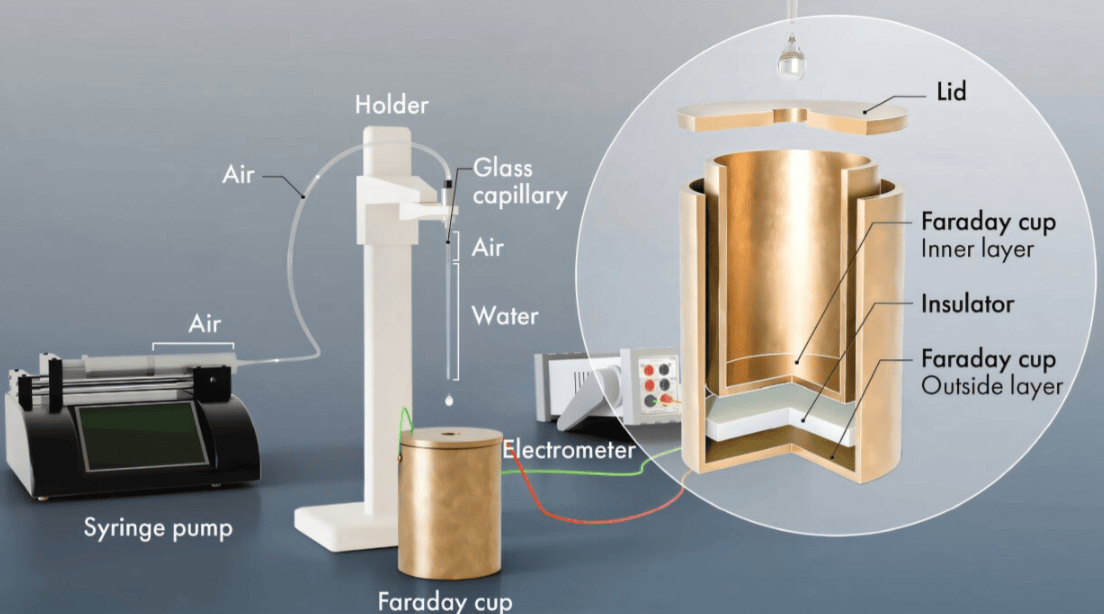

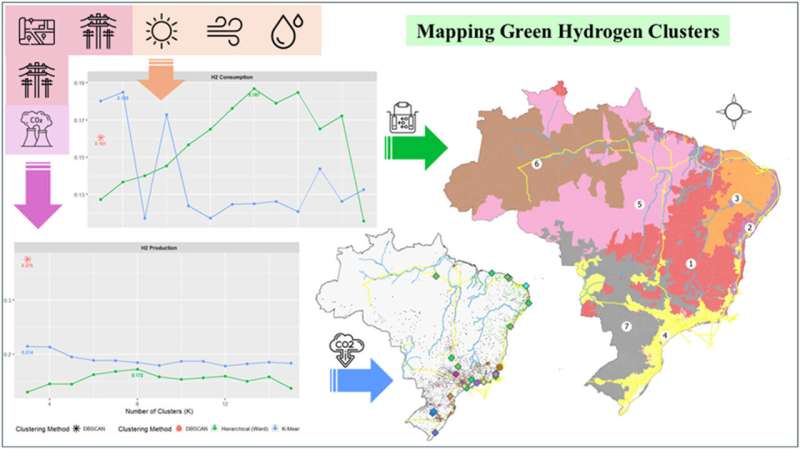

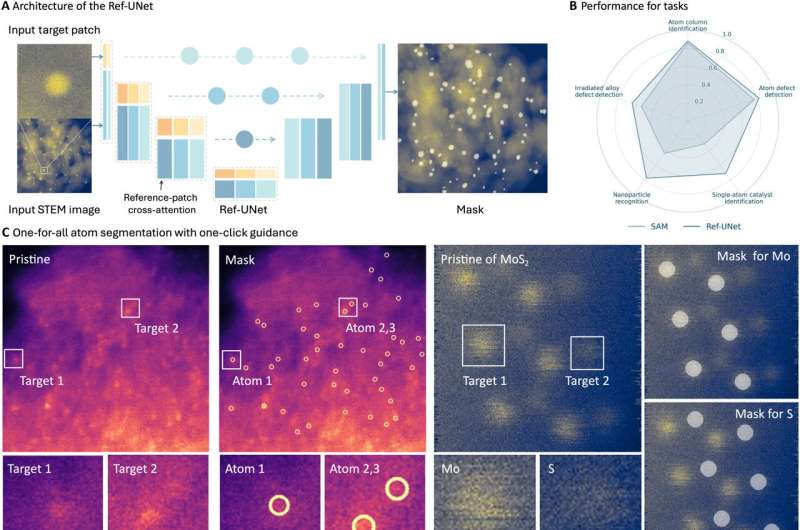

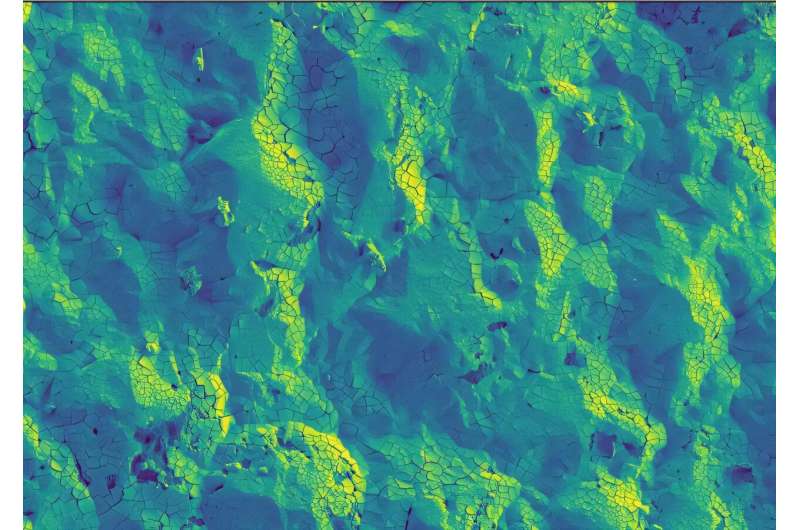

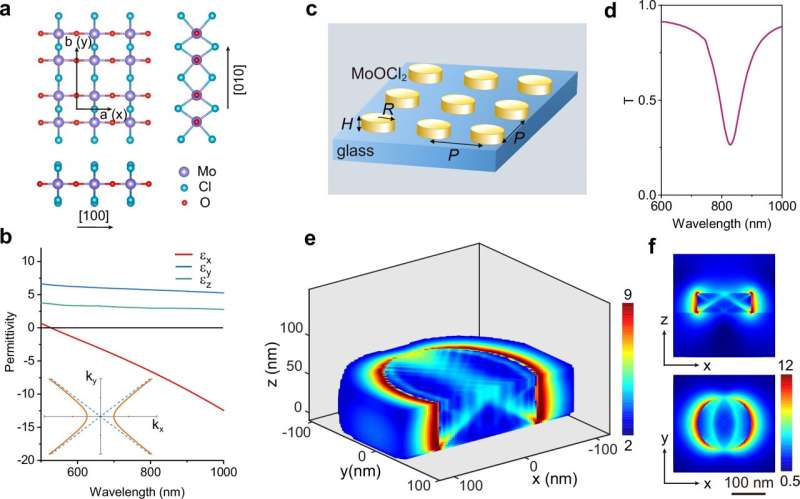

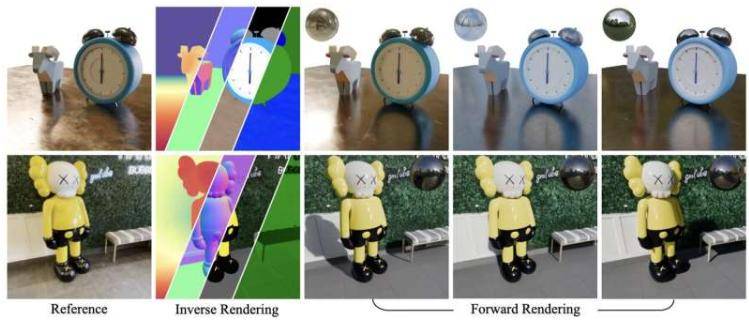

تكمن خصوصية DiffusionRenderer في دمج الذكاء الاصطناعي التوليدي في قلب سير عمل الرسومات، مما يجعل المهام التقليدية المستهلكة للوقت مثل إنشاء الأصول، وإعادة الإضاءة، وتحرير المواد أكثر كفاءة. تعتمد طريقة العرض العصبي الجديدة هذه على نماذج الانتشار، حيث تقوم بتحسين الضوضاء العشوائية تدريجيًا لتوليد رسومات مترابطة. وعلى عكس تقنيات توليد الصور السابقة، يولّد DiffusionRenderer أولاً G-buffer، ثم يستخدم هذه التمثيلات لإنشاء صور جديدة واقعية.

في المستقبل، من المتوقع أن يفيد DiffusionRenderer باحثي الروبوتات والمهنيين الإبداعيين. وهو ذو قيمة كبيرة لمنشئي المحتوى في الألعاب الإلكترونية، والإعلانات، أو إنتاج الأفلام، حيث يمكنهم إضافة أو حذف أو تحرير خصائص معينة بدقة عالية. كما يمكن لعلماء الحاسوب استخدامه لإنشاء بيانات واقعية لتدريب الروبوتات أو خوارزميات تصنيف الصور.